Battery Included interview

Interview mit Simon Reichel, Gründer und Geschäftsführer von BatteryIncluded

BatteryIncluded klingt wie ein Versprechen: Sofort einsatzbereit. Warum ist Site-Search 2026 trotzdem für so viele Händler ein ungelöstes Problem?

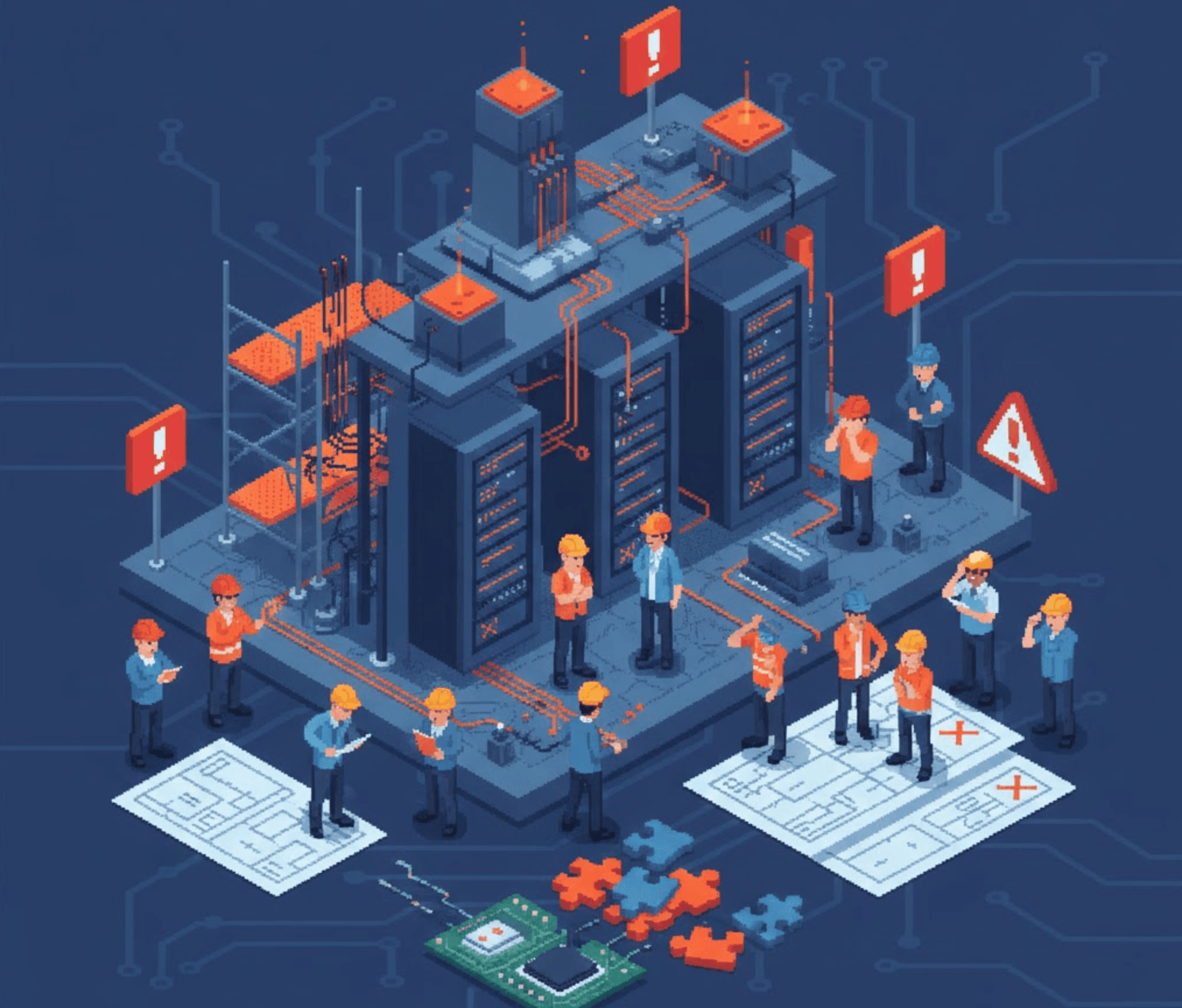

Weil die meisten Plattformen immer noch in Silos funktionieren. Man holt sich eine Commerce Architektur und denkt, die Suche sei ein Feature, das einfach dabei ist. Aber B2B-Daten sind wild: unstrukturierte Attribute, hunderte SKUs mit minimalen Unterschieden, komplexe Abhängigkeiten. Wir bei BatteryIncluded haben den Framework-Gedanken perfektioniert. Wir sind kein geschlossenes System, sondern der Data Discovery Core, der sich nahtlos in die bestehende Architektur einfügt. Das Problem heute ist nicht der Mangel an Technologie, sondern die mangelnde Fähigkeit, Daten zu nutzen, so dass sie dem Nutzer Orientierung bieten. Wir lösen das mit unserem Relevance Stream, der User-Metadaten mit den harten Produktdaten verheiratet und selbstlernend automatisch bessere Relevanz liefert.

Wie unterscheidet sich das Suchverhalten im B2B fundamental vom B2C?

Im B2C suchen Sie zur Inspiration. Im B2B ist die Suche ein Arbeitswerkzeug. Ein Einkäufer will nicht „shoppen“, er will „finden und weitermachen“.

Technisch: Wir müssen Einheiten verstehen (10mm = 1cm), Synonyme wie „Inbus“ vs. „Innensechskant“ auflösen und Bauteile anhand von Teile-Fragmenten finden.

Funktional: Die Fehlertoleranz muss extrem hoch sein, während die Präzision bei technischen Parametern absolut sein muss. Wer bei uns nach einer DIN 912 sucht, darf keine DIN 913 sehen, nur weil der Algorithmus „ähnlich“ denkt.

Ab welcher Komplexität macht eine native Suche keine Freude mehr?

Spätestens ab 10.000 SKUs oder wenn Sie mehr als 20 technische Attribute pro Artikel haben. Sie erkennen das konkret an zwei Dingen: Erstens, Ihre Null-Treffer-Quote steigt bei Fachbegriffen. Zweitens, die Ladezeiten der Filter explodieren. Wenn ein Einkäufer drei Sekunden warten muss, bis die Facetten links nachladen, haben Sie ihn verloren. Wir sehen bei Kunden wie Office Partner oder Wurm, dass durch die Entkopplung der Suche vom Shop-Kern die Performance massiv steigt. Wir reden hier von einer bis zu 3x schnelleren Integration im Vergleich zu monolithischen Lösungen.

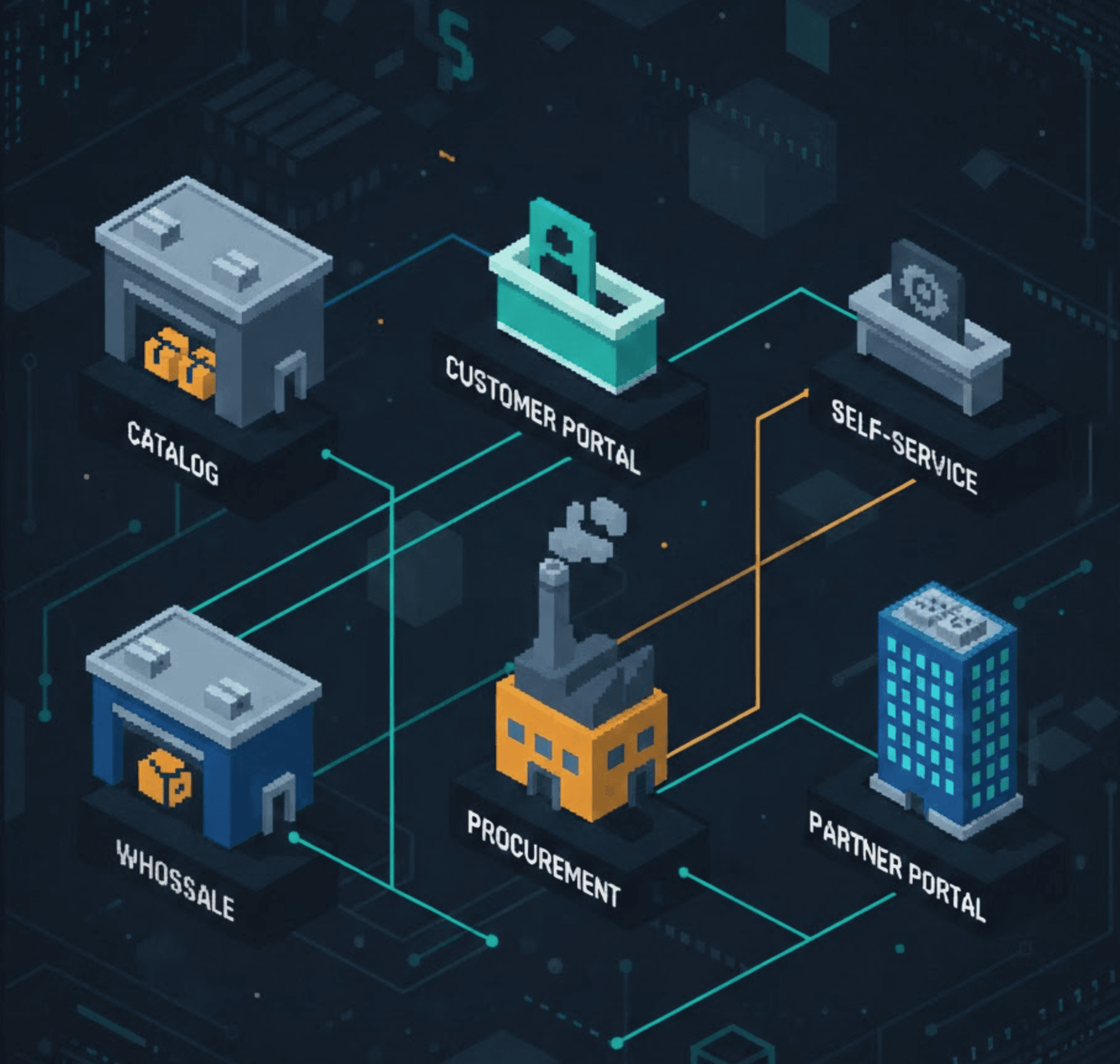

Kundenindividuelle Preise und Sortimente: Darf ein Kunde wirklich nur sehen, was für ihn freigegeben ist?

Absolut. Das ist die Königsdisziplin im B2B. Viele Standard-Suchen scheitern daran, weil wenn Usergruppen, Embargologiken und eine große Datenmenge durch kundenspezifische Preise, Sichtbarkeits- oder Verfügbarkeitslogiken zu indexieren sind. Ändert sich ein Preis im ERP, ist der Index veraltet. Unsere Engine geht hier einen anderen Weg: Wir verarbeiten Echtzeit-Rohdaten als Delta-Updates. Wir können kundenindividuelle Sortimente und Preise in den Suchprozess einweben, ohne den Index aufzublähen. Wir haben hierfür abseits von “scoped API keys” mit einer eigens entwickelten Varianten- bzw. Locale-Logik ein mächtiges Werkzeug zum maximal effizienten Datenhandling ins Leben gerufen. Ein Einkäufer bei uns sieht nur das, was er kaufen darf, zu seinem Preis. Das ist kein „Nice-to-have“, sondern die Basis für Vertrauen im digitalen Vertrieb.

Ihr habt Hybrid LLM Search eingeführt. Eine Kombination aus eurem Core und Gemini. Was war der konkrete Auslöser? Habt ihr gesehen, dass User anfangen, in natürlicher Sprache zu suchen?

Absolut. Der Auslöser war der „ChatGPT-Effekt“ im B2B. Die Erwartungshaltung hat sich massiv verschoben: Einkäufer wollen keine Keywords mehr jonglieren, sie wollen Antworten auf komplexe Fragen. Wir haben uns deshalb gegen eine einfache „Drüberstülp-Lösung“ entschieden. Stattdessen nutzen wir eine native Hochleistungs-Schnittstelle, die unseren Such-Core direkt mit Gemini verheiratet. Das ist kein loses Aneinanderketten von Tools, sondern eine tiefe Integration. Warum der Aufwand? Herkömmliche Suchen, auch viele moderne Vektorsuchen, sind stumm, wenn es um echte Konversation geht. Wenn ein Nutzer fragt: „Was brauche ich für eine Außenmontage bei Frost?“, dann ist das kein Suchbegriff, sondern ein technisches Problem. Durch unseren nativen Connector versteht das System die Absicht hinter der Frage in Echtzeit. Gemini fungiert hier als das „Gehirn“, das die natürliche Sprache präzise in technische Filterparameter für unseren extrem schnellen Index übersetzt. Wir kombinieren die brachiale Geschwindigkeit unserer Engine mit der semantischen Tiefe von Gemini. So verwandeln wir den Suchschlitz in einen digitalen Fachberater, der versteht, dass „Frost“ im Kontext von Schrauben zwangsläufig Edelstahl oder eine spezielle Verzinkung bedeutet.

LLMs halluzinieren. Ein bekanntes Problem. Wie verhindert ihr in der Praxis, dass ein nicht-existentes Produkt empfohlen oder eine falsche Spezifikation ausgegeben wird?

Das ist ein Punkt, bei dem wir uns ganz klar vom Markt abheben. Viele setzen auf den klassischen RAG-Ansatz (Retrieval Augmented Generation), bei dem die KI am Ende einen Antworttext „würfelt“. Das ist im B2B-E-Commerce brandgefährlich.

Wir bei BatteryIncluded nutzen kein RAG.

Stattdessen verwenden wir Gemini über einen nativen Connector als intelligenten Übersetzer. Die KI agiert bei uns wie ein fachkundiger Lotse: Sie übersetzt die natürliche Sprache (Natural Language Query) des Nutzers in Millisekunden in hochpräzise, strukturierte Filterbefehle für unseren Such-Core.

Der Clou dabei: Die Produktdaten, Spezifikationen und Preise kommen niemals „aus dem Gedächtnis“ der KI. Sie kommen immer unverfälscht und direkt aus unserem autoritativen Index. Die KI „erfindet“ also keine Antwort, sondern sie bedient die Suchmaschine so perfekt, wie es ein Mensch niemals könnte. Halluzinationen sind damit technisch ausgeschlossen, weil die KI keine inhaltliche Freiheit hat, Produktdaten neu zu schreiben. Sie steuert nur die Auswahl. Die Fakten bleiben zu 100 % in Ihrem System.

SaaS aus Deutschland? Wie konkret ist diese Aussage bei euch, und was bedeutet das für Datenhaltung und Verarbeitung?

Das ist für uns eine Frage der Haltung. Während US-Anbieter oft Blackboxes sind, bei denen Daten quer über den Globus fließen, verbleibt bei uns alles in einem geschlossenen, DSGVO-konformen Kreislauf. Da wir Gemini über Enterprise-Schnittstellen an unseren Core anbinden, stellen wir sicher, dass wertvolle Katalogdaten und das Suchverhalten der Endkunden nicht zum Training öffentlicher Modelle verwendet werden. Wir nutzen die Intelligenz des Sprachmodells, ohne Ihre Daten preiszugeben. Das ist „AI made in Germany“ mit der Power der weltbesten Modelle. Sicher, skalierbar und ohne rechtliche Grauzonen.

Was ist der Unterschied zwischen einer gut konfigurierten Suche und einer selbstlernenden Engine wie eurer? Ist dieser Unterschied für einen Mittelständler spürbar?

Eine klassische Suche ist wie ein statisches Regal: Wenn Sie nicht exakt wissen, wo was steht, suchen Sie ewig. Eine selbstlernende Engine wie unsere ist ein Framework, das versteht, wie Ihre Kunden arbeiten. Der Unterschied ist massiv, gerade für den Mittelstand: Sie müssen nicht mehr tausende Synonym-Listen händisch pflegen. Unser System lernt durch die native Verzahnung von Sprachverständnis und Klick-Daten, was gemeint ist. Für einen Mittelständler mit 200 Bestellungen am Tag bedeutet das: Weniger Abbruchraten, zufriedenere Einkäufer und ein Shop, der sich anfühlt, als würde er mitdenken. Das ist Data Discovery auf einem Level, das früher nur den Top-5-Playern im Markt vorbehalten war.

Wo endet die KI und beginnt der Fachberater?

Die KI ist der Vorsortierer. Sie kann 500.000 Schrauben auf die 3 reduzieren, die für „Stahlkonstruktion bis -20°C“ technisch geeignet sind. Das spart dem Fachberater die Zeit für die Katalog-Wälzerei. Der Fachberater übernimmt dann dort, wo es um Haftung, Projektplanung oder komplexe Systemberatung geht. Die KI macht den Weg frei für das wirklich wertvolle Gespräch.

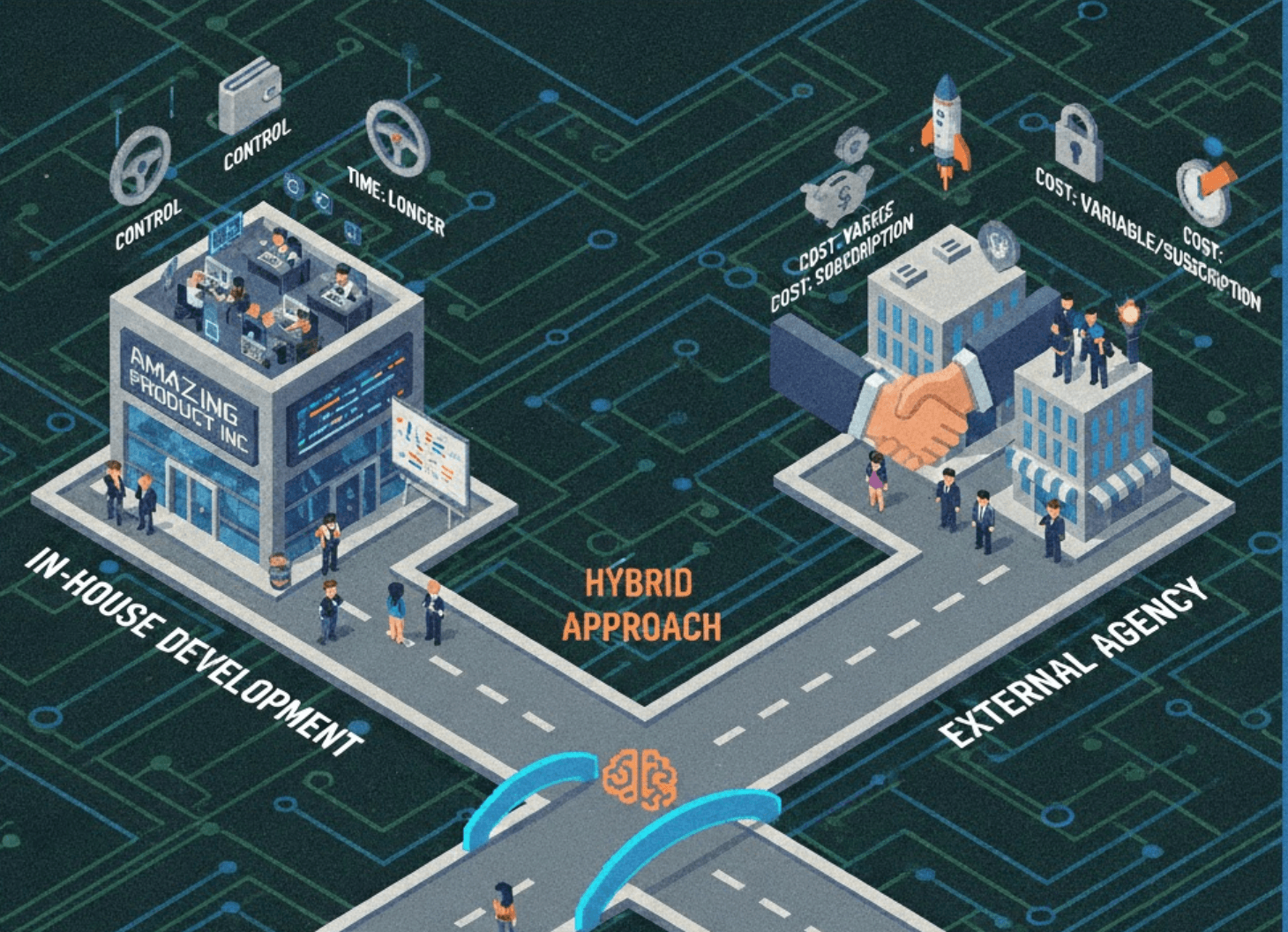

SaaS vs. Eigenbau: Warum sollte ich nicht selbst etwas mit Elasticsearch bauen?

Weil Sie ein Handelsunternehmen sind und kein Softwarehaus für Suchalgorithmen. Ein „Marke Eigenbau“ sieht am Anfang günstig aus, wird aber zur Wartungsfalle. Wer pflegt die Synonyme? Wer optimiert das Ranking? Wer integriert das LLM? Wir sind ein Framework, das „Ready to go“ ist. Wir übernehmen das „Heavy Lifting“ der Datenverarbeitung, damit Ihr Team sich auf das Merchandising konzentrieren kann. Unsere Kunden wie GoldSilberShop oder Shop4Runners beweisen, dass die Zeitersparnis bei der Verwaltung den Preis für die SaaS-Lösung bei Weitem aufwiegt. Wir haben auch einen dedizierten Artikel hierzu released: https://batteryincluded.ai/blog/ai-search/saas-vs-eigenentwicklung-ecommerce-suche/

Conversion-Raten: Habt ihr konkrete Zahlen?

Wir sehen regelmäßig, dass Nutzer mit Suche 3-mal häufiger konvertieren als „Browser“. Aber der eigentliche Hebel ist der Warenkorbwert. Durch Features wie AI Recommendations und Volt Merch (unsere Lösung für intelligentes Merchandising) konnten wir bei Kunden den Average Order Value (AOV) nachhaltig steigern. Wenn die Suche nicht nur findet, was gesucht wurde, sondern intelligent ergänzt („Andere kauften auch...“), dann arbeitet die Suche als Ihr bester Verkäufer.

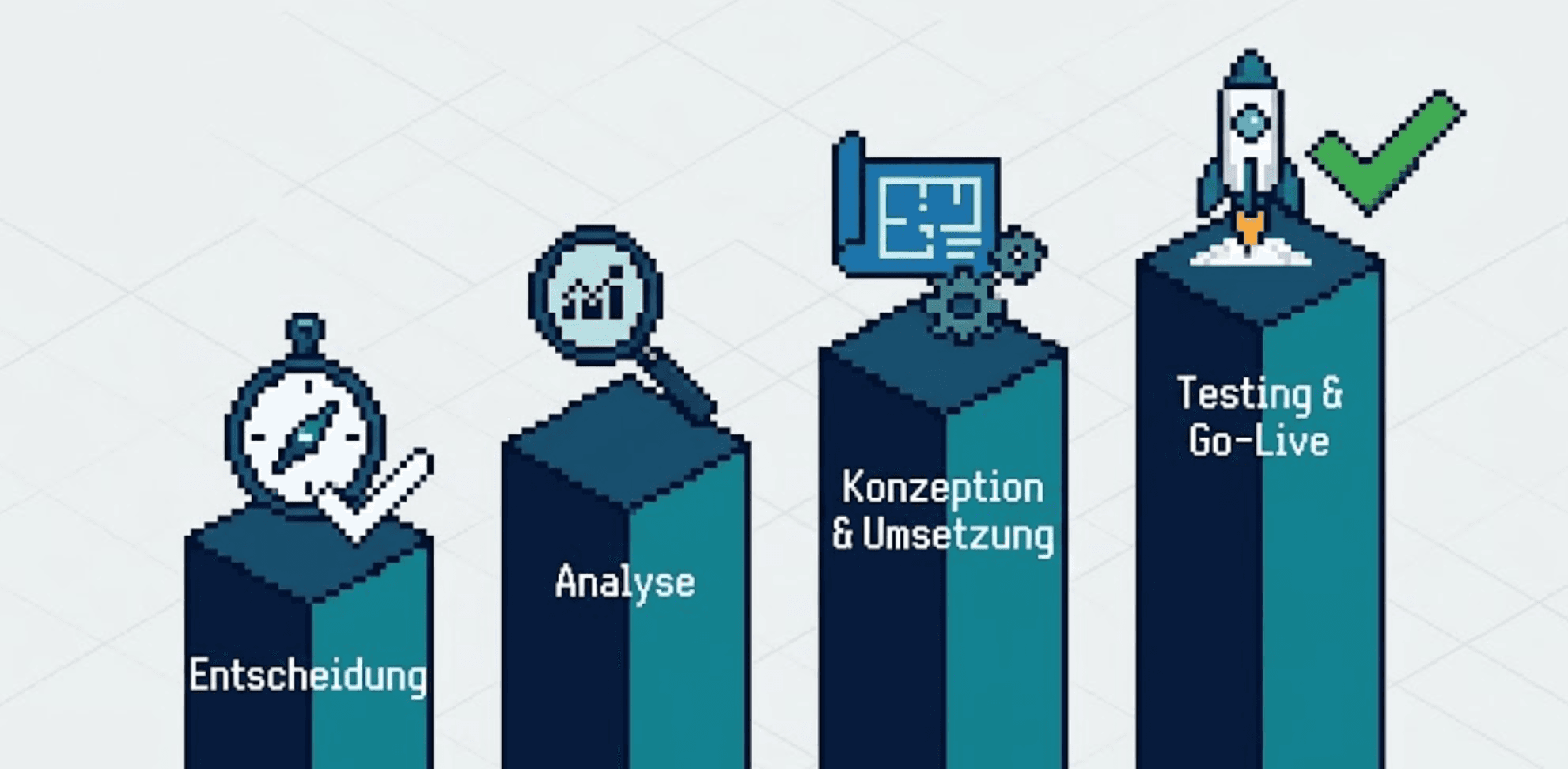

Wie lange dauert die Implementierung?

Dank unseres API-First-Ansatzes sind wir zumeist innerhalb von 4 bis 8 Wochen live. Wer Zeit einplanen muss? Primär das E-Commerce-Team für die Definition der Business-Logik (Ranking-Regeln) und die IT für die initiale Datenanbindung. Da wir aber fertige Konnektoren für Systeme wie Shopware 6 oder Emporix haben, ist der technische Aufwand überschaubar.

Ihr übernehmt auf Wunsch sogar PDPs und Listings. Warum dieser tiefe Eingriff?

Weil wir die Performance-Hoheit sicherstellen wollen. Wenn wir die Produktdetailseiten (PDP) direkt aus unserem Core rendern, entfällt der „Flaschenhals“ des oft langsamen Shop-Backends. Das Ergebnis ist eine User Experience, die sich so schnell anfühlt wie eine lokale App. Betreiber sollten dabei im Kopf haben: Sie geben nicht die Kontrolle ab, Sie gewinnen Geschwindigkeit und Flexibilität für globale Rollouts.

Ihr Tipp für einen Head of E-Commerce, den er morgen umsetzen kann?

Der Dolmetscher-Check: Setzen Sie sich morgen für eine Stunde mit Ihren Kollegen aus dem technischen Vertrieb oder dem Telefon-Support zusammen. Fragen Sie sie nicht nach Umsätzen, sondern nach den Vokabeln, die Kunden am Telefon nutzen, um Produkte zu beschreiben. Vergleichen Sie diese Begriffe danach mit den Attributen in Ihrem PIM oder ERP. Sie werden feststellen: Ihre Kunden sprechen oft eine ganz andere Sprache als Ihre Datenbank.

Diesen Language Gap zu erkennen, ist der erste Schritt zu einer funktionierenden Suche. Völlig egal, welche Technologie Sie am Ende einsetzen.“